Konferencja Mega Sekurak Hacking Party w Krakowie – 26-27 października!

Adminie… Czy znamy Twoje grzechy? ;-) Sprawdź!

Konferencja Mega Sekurak Hacking Party w Krakowie – 26-27 października!

Adminie… Czy znamy Twoje grzechy? ;-) Sprawdź!

Szpiegostwo technologiczne, wykradanie danych stanowiących tajemnicę przedsiębiorstwa, czy też inne działania ukierunkowane na pozyskiwanie informacji to zagrożenia, z którymi musi się zmierzyć każdy, kto wprowadza na rynek innowacyjne rozwiązania. Dla liderów w branży taki wyciek nie oddziałuje tylko na wizerunek firmy, ale stanowi realne ryzyko upadku biznesu.

TLDR:

o tej pory byliśmy przyzwyczajeni do ataków, w których cyberprzestępcy stosując socjotechnikę lub niezałatane podatności włamują się do infrastruktury firmy, a następnie dokonują cichej eksfiltracji danych. Najbardziej zaawansowane metody (trudne do wykrycia) stosują grupy APT. Ostatnie kampanie, które przypisuje się do chińskich grup udowodniły, że aktorzy (ang. threat actors) są w stanie utrzymać się wewnątrz sieci przez dni, miesiące, a nawet lata, pozostając w całkowitym ukryciu.

Najnowszy raport Anthropic pokazuje, że w dobie AI walka o własność intelektualną ewoluuje i przenosi się na zupełnie nowy poziom. I nie mamy tu na myśli sal sądowych, gdzie gigantom technologicznym takim jak Anthropic czy OpenAI stawia się zarzuty kradzieży danych do szkolenia własnych modeli. Często procesy te kończą się po myśli oskarżających, jednak nie o tym mowa.

Chcąc zdobyć wiedzę, którą dysponuje AI nie trzeba stosować skomplikowanych metod ataku na aplikację WWW, czy też szukać podatności w infrastrukturze na której hostowany jest produkt. Wystarczy skłonić model do udzielania odpowiedzi na starannie przygotowane pytania. Coś na zasadzie nauczyciel → student.

Badacze opisują to jako zjawisko, w którym “student” (chiński model) nie tylko kopiuje odpowiedzi od “nauczyciela” (Claude), ale wręcz dąży do tego, aby poznać jego sposób rozumowania i generowania odpowiedzi. To właśnie na tym polega mechanizm distillation attack, który w rękach zdeterminowanych atakujących, stał się skutecznym narzędziem do zdobywania informacji.

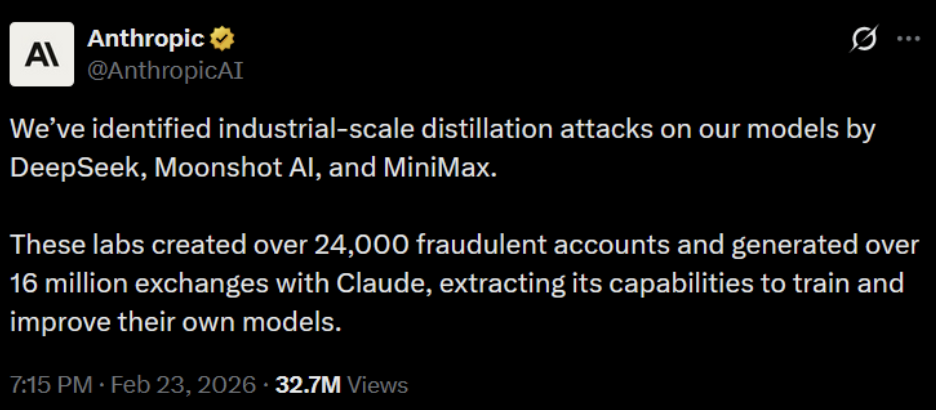

Anthropic poinformował o wykryciu aktywnych kampanii wymierzonych bezpośrednio w Claude. Za atakami stoją najprawdopodobniej trzy czołowe chińskie firmy technologiczne DeepSeek, Moonshot AI oraz MiniMax. Badacze zaobserwowali nietypowy ruch pochodzący z ponad 24 tys. kont, co pozwoliło na wygenerowanie blisko 16 milionów interakcji z modelem. Stanowiło to naruszenie warunków świadczenia usług oraz regionalnych ograniczeń dostępu do Claude.

Ponadto, atakujący korzystali z komercyjnych usług proxy oraz sieci nazywanych przez badaczy hydra cluster, aby ominąć ograniczenia regionalne i uzyskać masowy dostęp do modelu Claude. Usługi te opierają się na architekturze, w której tysiące fałszywych kont tworzą rozproszoną sieć, gdzie ruch przechodzi przez zewnętrzne platformy chmurowe. Działanie te mają na celu ukrycie pochodzenia zapytań i skutecznie wmieszanie się w legalny ruch użytkowników.

Co ciekawe, w przypadku wykrycia anomalii i zablokowania konta, operacja nie była przerywana. Jego miejsce natychmiast zajmowało kolejne konto, a zadanie było kontynuowane. W szczytowej fazie, badacze zaobserwowali ponad 20 tys. aktywnych kont.

DeepSeek skupił się przede wszystkim na wymuszaniu na modelu Claude szczegółowego opisywania toku rozumowania (ang. chain-of-thought). Nie zależało im na końcowej odpowiedzi, tylko na sposobie dochodzenia do wyników.

Dodatkowo, Claude został wykorzystany jako narzędzie służące do generowania poprawnie politycznych treści. Atakujący zadawali pytania na wrażliwe tematy polityczne i na podstawie udzielonych odpowiedzi przygotowywali dane treningowe dla własnych modeli. Działanie te miały na celu nauczenie modelu sterowania rozmową w taki sposób, aby tematy uważane przez chińskie władze za niebezpieczne były skutecznie unikane (nałożenie cenzury).

Co ciekawe, Claude pełnił również funkcję tzw. “sędziego” oceniający wyniki generowane przez chińskie modele. W praktyce oznaczało to, że model stawał się nadzorcą podczas uczenia poprzez wzmacnianie (tzw. reinforcement learning).

W porównaniu z innymi firmami, skala ataku wydaje się niewielka – odnotowano ok. 150 tys. interakcji z Claude. Była to jednak precyzyjna operacja nastawiona na ekstrakcję danych o “wysokiej jakości”. Oczywiście raport nie zawiera informacji o jakie dane dokładnie chodziło, przypadek czy celowe działanie marketingowe?

Moonshot AI prowadził kampanię ukierunkowaną na zdobywanie informacji o programowaniu, sposobach analizy danych oraz obsługiwaniu interfejsów systemowych przez agentów AI. Zależało im na poznaniu metod, w jaki sposób model przetwarza informacje, zwłaszcza pochodzące z różnych źródeł (tekst, obraz). Skala ataku robi wrażenie, zaobserwowano ponad 3,4 mln interakcji. Podobnie jak w przypadku DeepSeek, w momencie wykrycia nietypowej interakcji i zablokowania konta użytkownika, zadanie było kontynuowane z użyciem innego kanału (adres IP i dane konta).

W kampanii przypisanej MiniMax, atakujący postanowili skupić się na maksymalnej ekstrakcji danych. Nawiązali blisko 13 milionów interakcji i to zaledwie po 24 godzinach od udostępnienia najnowszej wersji Claude. Ich działania skupiały się przede wszystkim na zaawansowanych funkcjach oferowanych przez model w zakresie programowania agentowego oraz tzw. orkiestracji narzędzi. Chodzi tu o umiejętność modelu do samodzielnego zarządzania wieloma narzędziami i procesami, w celu tworzenia skomplikowanych rozwiązań.

Zaobserwowane kampanie pokazują, że chińskie firmy dysponują precyzyjnymi procedurami oraz odpowiednio przygotowaną infrastrukturą, która jest gotowa do działania niemal natychmiast po wystąpieniu sprzyjających okoliczności. Takie podejście sprawia, że tradycyjne metody zabezpieczeń oparte na limitach zapytań stają się niewystarczające, a kluczowego znaczenia nabiera analiza behawioralna.

Na początku należy wyjaśnić, w jaki sposób Anthropic był w stanie precyzyjnie zidentyfikować tysiące kont zaangażowanych w kampanie. Od razu zaznaczamy, że zgodnie z deklaracją firmy każde zapytanie do API jest monitorowane z wykorzystaniem automatycznych systemów klasyfikacji, aby przeciwdziałać nadużyciom. Systemy te mają nie skupiać się na prywatnej treści, lecz na strukturze i charakterze zapytań.

Pozwala to wyłapać anomalie, takie jak nienaturalna powtarzalność tematów, specyficzna struktura promptów. Całość dopełnia analiza metadanych: adresów IP, sygnatur infrastruktury, korelacja czasowa zapytań (odróżnienie normalnej aktywności użytkownika od zautomatyzowanych narzędzi – botów).

Mimo iż atakujący stosowali różne metody anonimizacji, to zapomnieli o jednej niezwykle ważnej rzeczy, a mianowicie o dobrym OPSEC-u. Wiele zapytań przesyłanych z fikcyjnych kont zawierało metadane, które pokrywały się z publicznymi profilami zawodowymi wyższej kadry badawczej i inżynierów z DeepSeek oraz Moonshot AI.

Co więcej, analitykom z Anthropic udało się powiązać fragmenty ruchu z infrastrukturą sieciową bezpośrednio należącą do chińskich laboratoriów badawczych czołowych firm technologicznych. Ponadto analiza treści zapytań oraz specyficzny format zwracanych odpowiedzi, pozwoliły potwierdzić, że atakujący prowadzą działania mające na celu przygotowanie danych testowych do nauki własnych modeli. Zagadnienia poruszane podczas interakcji pokrywały się z aktualnymi projektami badawczymi, realizowanymi przez ww. firmy.

Wisienką na torcie okazały się błędy związane ze sposobami płatności za korzystanie z Claude. Analitycy wykryli, że wiele kont korzystało z tych samych metod płatności, co w konsekwencji pozwoliło na przypisanie poszczególnych kont do większych grup (m.in. należących do DeepSeek).

Bazując na doświadczeniach nabytych podczas ostatnich incydentów, inżynierowie z Anthropic zapowiadają wdrożenie wielowarstwowych mechanizmów obronnych. Oprócz automatycznych klasyfikatorów analizujących ruch API w czasie rzeczywistym, zapowiadają wdrożenia zaawansowanych systemów analizy behawioralnej.

W przypadku wykrycia podejrzanych aktywności zespół analityków przeprowadzi dodatkową weryfikację zdarzenia. Pozwoli to jednoznacznie ocenić sytuację i zminimalizuje ryzyko zablokowania dostępu legalnym użytkownikom, korzystającym z produktu zgodnie z licencją.

Dla zwykłego użytkownika, stopniowo wdrażane mechanizmy bezpieczeństwa nie wpłyną na jakość generowanych odpowiedzi, ani nie utrudnią korzystania z Claude. Niewykluczone jednak, że w przypadku korzystania z API mogą pojawić się pewne ograniczenia w częstotliwości przesyłania zapytań (ang. rate limiting) oraz okresowo może wystąpić potrzeba potwierdzenia swojej tożsamości.

Źródło: anthropic.com

~_secmike

Nigdy nie pytaj:

* Mężczyzny o zarobki

* Kobiety o wiek

* British Museum skąd ma eksponaty

* Anthropic/OpenAI/xAI/… skąd brali dane do uczenia swoich modeli

pff

warto obejrzeć

https://www.youtube.com/watch?v=_k22WAEAfpE