Firmy od dawna wiedzą, że phishing, socjotechnika i słabe hasła to realny problem. Ale jakiś czas temu na radarze pojawił się nowy przeciwnik, o którym wciąż niewiele się w mówi w organizacjach: deepfake. I nie mówimy tutaj o śmiesznych filmikach z Internetu, tylko realnych, skutecznych atakach na zarządy, działy finansowe…

Czytaj dalej »

Sprawę opisuje właśnie amerykański Departament Sprawiedliwości. A więc po kolei: Pierwszym krokiem było wyprodukowanie przez AI “setek tysięcy” utworów muzycznych. Utwory były następnie wrzucane na platformy: Spotify, Amazon Music, Apple Music oraz YouTube. Nazwy artystów też były fejkowe – Calm Baseball, Calm Connected, Calm Knuckles, Calliope Bloom, Calliope Erratum, Callous,…

Czytaj dalej »

Projektując aplikacje oparte na dużych modelach językowych (LLM) często mogą pojawić się trudności związane z efektywnym debugowaniem oraz testowaniem przepływu danych. W przypadku mniej skomplikowanych narzędzi można do tego celu użyć środowiska IDE (Integrated Development Environment). TLDR: Jeśli mowa o złożonych rozwiązaniach, integrujących modele językowe z bazami wektorowymi (architektura RAG)…

Czytaj dalej »

Historię opisuje brytyjski The Guardian, cytując lokalną prasę. Całość zaczyna się tak: siedzisz sobie w domu opiekując się dziećmi, a tu wkracza policja i wyprowadza Cię pod bronią…

Czytaj dalej »

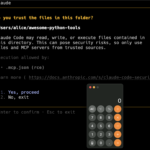

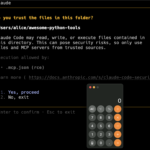

Badacze z Check Point Research odkryli podatności w Claude Code (Anthropic), które pozwalają atakującym na zdalne wykonanie kodu i kradzież kluczy API. Luki wykorzystują różne mechanizmy konfiguracji, w tym Hooks, serwery Model Context Protocol (MCP) oraz zmienne środowiskowe – umożliwiając wykonywanie poleceń i wykradanie poświadczeń, gdy użytkownik otworzy złośliwe repozytorium….

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

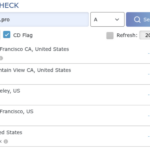

Badacze z Orca Security odkryli podatność prompt injection w GitHub Codespaces. Pozwoliło to w opisie (w ramach issues) przekazać modelowi złośliwe instrukcje i przy pomocy kilku narzędzi wykraść token wygenerowany dla danego środowiska. W efekcie umożliwiło to przejęcie kontroli nad repozytorium. TLDR: GitHub Issues to narzędzie do śledzenia zadań, błędów…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Badacze z LayerX odkryli kampanię rozszerzeń do Chrome, które podszywały się pod asystentów AI do streszczania, czatu, pisania i obsługi maili. Choć na pierwszy rzut oka narzędzia te wydają się wiarygodne, ich architektura umożliwia wprowadzenie “po cichu” dowolnych aktualizacji bez jakiejkolwiek zmiany w Chrome Web Store ani interakcji użytkownika. Wszystkie…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Chcesz ogarnąć ze mną niezbędne umiejętności dotyczące AI w 2026 roku i tym samym nie zostać w tyle? 24 kwietnia startuje kolejna edycja szkolenia ze mną, Tomkiem Turbą – Narzędziownik AI 2.0 Reloaded! To najbardziej kompletne szkolenie z AI w Polsce. Składa się z aż czternastu sesji, trwających po dwie…

Czytaj dalej »

Cześć! Z tej strony Tomek Turba. AI bez lukru to cykl moich felietonów o sztucznej inteligencji bez marketingowego lukru, bez korporacyjnych slajdów i bez bajek o “rewolucji, która wszystko zmieni”. Pokazuję AI taką, jaka jest naprawdę: z absurdami, wpadkami, halucynacjami i konsekwencjami, o których rzadko mówi się głośno. Bez zadęcia,…

Czytaj dalej »