Konferencja Mega Sekurak Hacking Party w Krakowie – 26-27 października!

Zaczęły pojawiać się scamy “na wnuczka” z głosem wygenerowanym przez sztuczną inteligencję. Washington Post.

Patrząc na obecne postępy w rozwoju sztucznej inteligencji, pojawienie się oszustw z tytułu wpisu było tylko formalnością. Jak donosi The Washington Post:

Oszuści używają sztucznej inteligencji, aby brzmieć bardziej jak członkowie rodziny będący w niebezpieczeństwie. Ludzie się na to nabierają i tracą tysiące dolarów.

Mężczyzna dzwoniący do Ruth Card brzmiał jak jej wnuk Brandon. Zatem kiedy powiedział, że jest w więzieniu, bez portfela ani telefonu komórkowego i potrzebuje gotówki na kaucję, Card zrobiła wszystko, co w jej mocy, by pomóc. Greg Grace pobiegła do swojego banku wypłaciła 3000 dolarów kanadyjskich…

Scammers are using artificial intelligence to sound more like family members in distress. People are falling for it and losing thousands of dollars.

The man calling Ruth Card sounded just like her grandson Brandon. So when he said he was in jail, with no wallet or cellphone, and needed cashfor bail, Card scrambled todo whatever she could to help. Greg Grace, 75, dashed to their bank in Regina, Saskatchewan, and withdrew 3,000 Canadian dollars ($2,207 in U.S. currency), the daily maximum.

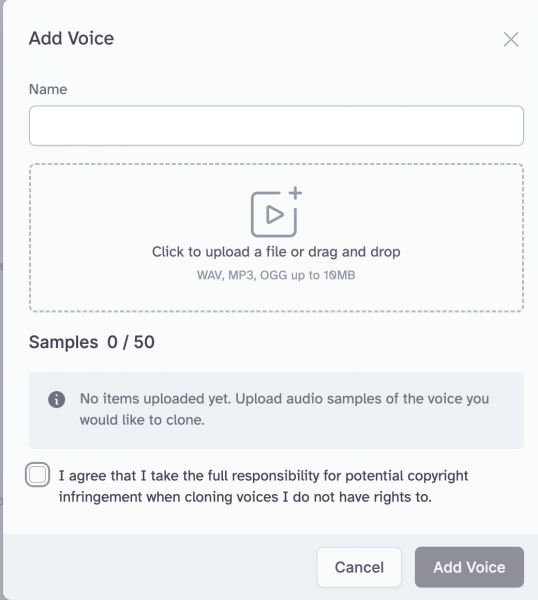

Być może użyto tutaj oprogramowania Elevenlabs, o którym pisaliśmy niedawno. Wystarczy uploadować tam niewielką próbkę głosu, który chcemy sklonować i po chwili można klonem wypowiadać dowolną frazę…:

Swoją drogą, tego samego tricku użyto ostatnio do ominięcia biometrii głosowej w jednym z brytyjskich banków:

~ms