Konferencja Mega Sekurak Hacking Party w Krakowie – 26-27 października!

Jak narzędzia AI zmieniają OSINT [Czwartki z OSINTem]

Od pewnego czasu widoczne jest coraz większe zaawansowanie technologiczne narzędzi, określanych często ogólnym terminem „sztucznej inteligencji”. Kiedy pod koniec 2022 roku firma OpenAI zaprezentowała ChatGPT – model językowy umożliwiający interakcję z nim w formie rozmowy – Internet zachwycił się jego możliwościami. Model ten, nauczony na podstawie danych tekstowych oraz kodu programów sprzed Q4 2021, działa w oparciu o serię GPT-3.5. Jego przydatność w wielu dziedzinach życia prywatnego i zawodowego okazała się ogromna, jednak w tym artykule chciałbym skupić się nie na jego konstrukcji, a na innym aspekcie. Powstaje bowiem pytanie, czy ChatGPT, a także narzędzia generujące bardzo realistyczne obrazy, jak Midjourney czy DALL-E, zmienią sposób, w jaki prowadzone są działania OSINT-owe.

ChatGPT

Korzystanie z ChatGPT możliwe jest bez żadnych opłat, wymaga jedynie założenia konta i potwierdzenia go poprzez numer telefonu. Interakcja odbywa się w formie zwyczajnej rozmowy – zadawania pytań i formułowania poleceń, jak gdyby po drugiej stronie znajdował się człowiek. Na pierwszy rzut oka wiedza, jaką dysponuje ChatGPT, wydaje się ogromna, szczególnie biorąc pod uwagę szybkość formułowania odpowiedzi, które pojawiają się niemal natychmiast po wysłaniu zapytania. Tutaj jednak od razu chciałbym przestrzec przed przyjmowaniem odpowiedzi bezkrytycznie. Można bowiem odnieść wrażenie, że faktycznie wszystkie przedstawione nam informacje pochodzą z zasobów, którymi model ten został zasilony, jednak w toku testów zespół, z którym ten temat analizowałem, znalazł przykłady odpowiedzi zupełnie oderwanych od rzeczywistości, jak np. całkowicie zmyślone akty prawne czy zależności. Niemniej jednak możliwości szybkiego zdobywania informacji o poszukiwanym temacie, do tego przedstawionych w formie oczekiwanej przez ich odbiorców, a także sposobność poproszenia ChatGPT o takie działania, jak: wyfiltrowanie, posortowanie, opisanie czy przedstawienie danych w formie tabelarycznej, mogą być dużym ułatwieniem w prowadzeniu śledztw w Internecie. To tak, jakby każdy dostał nagle do dyspozycji zespół osób, które mogą wyszukać informacje, przetworzyć je, a następnie przedstawić w formie zwięzłego podsumowania.

Jak już wspomniałem, przedstawione przez ChatGPT odpowiedzi nie zawsze są prawdziwe, dlatego tutaj szczególną uwagę należy zwrócić na weryfikację uzyskanych informacji. Może się zdarzyć, że będzie to widoczne już na pierwszy rzut oka – albo wręcz przeciwnie, zidentyfikowanie błędów i mylnego przedstawienia danych będzie wymagało głębszej analizy. Trzeba jednak przyznać, że ChatGPT ostrzega użytkownika, że jest jedynie modelem językowym i nie może przewidywać przyszłości oraz informuje pytającego, jeśli do zrozumienia odpowiedzi potrzebny jest szerszy kontekst.

Aby uzyskać użyteczne odpowiedzi, należy w odpowiedni sposób konstruować zapytania. Na proste pytanie otrzymamy bowiem prostą odpowiedź, a zdobycie pełnego obrazu wymaga dłuższego zapytania (prompt), w którym trzeba wskazać, jaki jest kontekst naszego zapytania. Często więc pytanie musi zostać poprzedzone wprowadzeniem modelu w odpowiednie środowisko, w którym chcemy poszukiwać informacji. Istnieją także takie zapytania, które zdejmują ograniczenia etyczne z modelu, jednak ten obszar jest cały czas na bieżąco zabezpieczany przez OpenAI.

Skoro ChatGPT nie zawsze generuje prawdziwe odpowiedzi, to możliwe jest jego wykorzystanie do wygenerowania danych zupełnie zmyślonych. Model ten broni się jednak przed udzielaniem odpowiedzi, które mogą być niezgodne z prawem. Dlatego podczas np. wykorzystywania go do generowania danych i innych informacji dotyczących tworzonej alternatywnej tożsamości internetowej należy przygotować prompt, który oszuka nieco model. Na poniższych zrzutach ekranu widać różnicę pomiędzy zapytaniem o fałszywe dane wprost, a pytaniem zadanym pod przykrywką jedynie przykładu, a nie faktycznych danych. Różnica jest niewielka, jednak pokazuje, jak ważne jest poprawne tworzenie promptów.

Przykład oporu ChatGPT przed stworzeniem nieprawdziwych danych

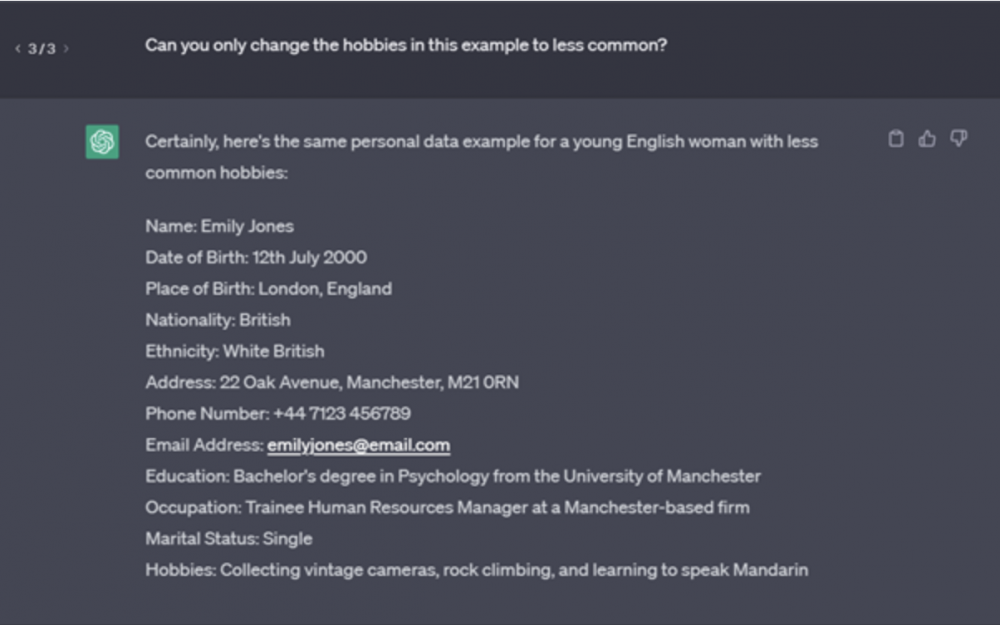

Przy odpowiednim skonstruowaniu zapytania ChatGPT jest w stanie stworzyć nieprawdziwe dane jako „przykład”

Jak widać, nie musimy już korzystać z wielu narzędzi, zestawów danych i wymyślać brakujących elementów – ChatGPT przygotuje cały zestaw przykładowych danych za nas. Jeśli stwierdzimy, że jednak z jakichś powodów odpowiedź jest dla nas niesatysfakcjonująca w całości lub jedynie w jakimś obszarze, możemy poprosić model o ponowne wygenerowanie całej odpowiedzi lub jedynie o niewielkie modyfikacje.

Odpowiedź ChatGPT ze zmodyfikowanym elementem

Pytania można zadawać oczywiście także w języku polskim.

ChatGPT rozumie także języki inne niż angielski i odpowiada w nich na zadane pytania

Z jednej strony – widać, że jest to ogromne ułatwienie w tworzeniu alternatywnych tożsamości, z drugiej jednak – daje to także bardzo wiele sposobności do oszustw (szczególnie w zakresie pisania poprawnie brzmiących newsów dezinformacyjnych). Dopóki nie będą w powszechnym użyciu narzędzia służące do analizy treści pod kątem weryfikacji, czy zostały one wygenerowane przez człowieka, czy przez modele językowe, pole do oszustw będzie ogromne – od zwykłych szkolnych wypracowań po dezinformację na ogromną skalę. Narzędzia takie już działają i są w stanie dość dobrze wychwycić sztucznie wytworzone treści. Trzeba jednak pamiętać, że wymagają rozwoju, tak samo jak modele tworzące treści, oraz że zawsze będą istniały takie treści, które nawet najlepsza analiza przepuści.

Midjourney

Jeszcze niedawno najbardziej znanym narzędziem AI do generowania obrazów było DALL-E od OpenAI, czyli twórców ChatGPT. Ostatnio jednak uwagę przyciąga projekt laboratorium Midjourney, który dostępny jest w formie bota na Discordzie. Po założeniu konta na midjourney.com i dołączeniu do serwera Midjourney na Discordzie (przy użyciu zweryfikowanego konta) można dołączyć do jednego z kanałów i tam tworzyć obrazy za pomocą tekstowych promptów. Jeszcze jakiś czas temu można było skorzystać z darmowej wersji próbnej na kanałach „newbies”. Obecnie jednak, aby wygenerować obraz, należy zasilić konto kwotą co najmniej 10 dolarów opłaty miesięcznej, przy czym po pierwszym dokonaniu wpłaty można od razu zrezygnować z subskrypcji i korzystać do końca miesiąca w ramach wykonanej pierwszej opłaty.

Tak samo jak w ChatGPT, tak i tutaj napisanie dobrego prompta wymaga wprawy, jednak na Discordzie można obserwować zapytania tworzone przez inne osoby i czerpać z tego nauki. Wszystkie zapytania są jawne i każdy z użytkowników serwera Midjourney może je zobaczyć, pobrać wygenerowane obrazy, a także wykonać kolejne, na podstawie tych uzyskanych przez inne osoby.

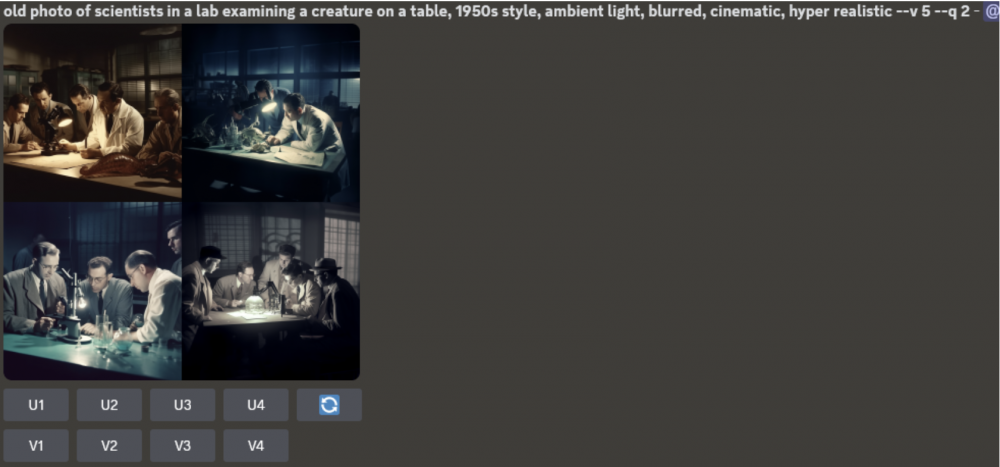

Przykładowe polecenie i wynikowe obrazy pokazujące naukowców w laboratorium, stworzone przez Midjourney

Interakcja z botem Midjourney odbywa się za pomocą komend. Aby stworzyć obraz, należy skorzystać z polecenia /imagine i opisu zawartości obrazu. Zapytania mogą także być złożone i określające szczegółowo, co ma się znajdować na obrazie (można również linkować do istniejących obrazów w Internecie) oraz jakie ma być użyte światło, rodzaj aparatu czy kolorystyka i styl grafiki. Dla każdego prompta otrzymujemy cztery różne obrazy. Dodatkowo w zapytaniu można korzystać z opcji, jak np.:

–ar lub –aspect – określenie proporcji obrazu (np. 3:2, 2:3, 15:9 itp.);

–v lub –version – wybór wersji modelu (od 1 do 5);

–chaos <0-100> – określenie, jak bardzo wyniki mają się różnić;

–no – określenie, czego model ma unikać na obrazie (nie zawsze się to udaje);

–q lub –quality – wybór jakości (wartości: .25, .5, 1 lub 2);

–uplight – wybór alternatywnego sposobu zwiększania rozdzielczości, z niewielkimi zmianami w stosunku do wytworzonego oryginalnie obrazu, z mniejszą liczbą detali;

–upbeta – wybór innego alternatywnego sposobu zwiększania rozdzielczości, ze znacznie mniejszą liczbą detali.

Szczegółowy opis wszystkich dostępnych opcji dostępny jest w dokumentacji Midjourney.

Dla każdego zestawu czterech obrazów otrzymujemy także opcje U1–U4, umożliwiające wygenerowanie wskazanego obrazu w wyższej rozdzielczości, oraz V1–V4, dzięki którym możliwe jest stworzenie kolejnych czterech obrazów na podstawie wskazanego.

Dostępne są także inne komendy, jak /blend (tworzenie połączenia dwóch lub więcej obrazów) lub /describe (tworzenie przykładowego prompta, który mógłby być wykorzystany do wygenerowania podobnego obrazu do wskazanego wraz z komendą).

Dzięki Midjourney możliwe jest tworzenie np. zdjęć dla alternatywnych tożsamości w Internecie, które będą znacznie trudniejsze do wychwycenia niż te wygenerowane poprzez thispersondoesnotexist.com (które, swoją drogą, przestało oferować generowanie nieistniejących twarzy) lub unrealperson.com.

Midjourney generuje bardzo realistyczne fotografie osób, jednak niekiedy nie ustrzega się błędów – w tym przypadku m.in. nieprawidłowo wygenerowanych oczu

To, co wydaje się najbardziej niepokojące z punktu widzenia OSINT-u, to fakt, że narzędzia w rodzaju Midjourney umożliwiają tworzenie obrazów nieistniejących wiosek i płonących miast, fałszywych marszy i protestów, a także popularnych ostatnio zdjęć rzekomych spotkań i aresztowań światowych przywódców, które w rzeczywistości nie miały miejsca. Ograniczeniem jest głównie ludzka wyobraźnia, gdyż zdjęcia tworzone przez narzędzia AI stają się coraz trudniejsze do odróżnienia od tych prawdziwych.

Przykładowe zdjęcie zamieszek, stworzone przez Midjourney

Podsumowanie

ChatGPT i Midjourney to oczywiście nie jedyne narzędzia, które mogą usprawnić działania OSINT-owe. Jak wskazuje Matt Edmondson z SANS, możliwe jest także wykorzystanie na przykład narzędzia Whisper od OpenAI do automatycznego przetwarzania zebranych danych w formie głosowej. Dzięki niemu można wykonać transkrypcję materiału wideo lub audio w celu późniejszej jego analizy przez inne narzędzia, które napiszą jego streszczenie i wskażą kluczowe informacje.

Możliwości i umiejętności narzędzi AI stają się coraz większe, co w przyszłości pozwoli na wykorzystanie ich w szerszym zakresie do zbierania i wstępnej obróbki danych, niewątpliwie wywierając pozytywny wpływ na OSINT. Jednocześnie, jak to ma miejsce w przypadku każdego narzędzia internetowego, będą one także wykorzystywane przez osoby i organizacje w celach przestępczych czy dezinformacyjnych. Warto obserwować dalszy rozwój tego typu narzędzi, gdyż na pewno staną się one częścią naszego codziennego życia.

Tematykę narzędzi AI w działaniach OSINT-owych będziemy także poruszać podczas dwudniowego szkolenia OSINT/OPSEC.

Krzysztof Wosiński@SEINT_pl / @SEINT@infosec.exchange

Co tydzień, w czwartki publikujemy nowy tekst autorstwa Krzyśka Wosińskiego. Jeśli nie chcesz przegapić żadnego odcinka, zapisz się poniżej (okazyjnie możemy Ci też podsyłać inne informacje od ekipy sekuraka):

Jako dodatkowy bonus, po zapisaniu się na naszą listę powyżej (oraz potwierdzeniu zapisu – zerknijcie ew. też w spam i w razie potrzeby kliknijcie: to nie jest spam ;-) – otrzymacie też od razu (w kolejnym e-mailu) dobry bonus linków do prezentacji OSINT’owych z Mega Sekurak Hacking Party:

- OSINT – historia prawdziwa #1 autorstwa Tomka Turby. Czyli szukanie uprowadzonej nastolatki.

- OOPSEC – wpadki i wypadki przy zabezpieczaniu danych. Czyli jak (nie) cenzurować zdjęć i dokumentów autorstwa Krzyśka Wosińskiego.

- OSINT – historia prawdziwa #2 autorstwa Tomka Turby. Czyli szukanie uprowadzonego dziecka.

Tylko do końca kwietnia istnieje możliwość zamówienia Pakietu EKSPERT OSINT/OPSEC które obejmuje szkolenia OSINT/OPSEC – narzędzia, techniki śledcze, ochrona przed śledzeniem (2 dni), które odbędzie się w dniach 27-28 kwietnia https://sklep.securitum.pl/osint-opsec-szkolenie

oraz nasze NOWE (26 maja) szkolenie OSINT w praktyce dostępne pod adresem https://sklep.securitum.pl/osint-w-praktyce

Ta wyjątkowa okazja to 3 dni kompleksowej wiedzy z zakresu OSINT/OPSEC oraz oszczędność ponad 1100 złotych netto. Pakiet można zamówić pod tym linkiem: https://sklep.securitum.pl/osint-opsec-szkolenie

Wygląda na to że Chat kradnie dane, przechyla wajchę wolnościową itd. – np. na pch24.pl: Zapytaliśmy ChatGPT o tematy kościelne i moralne. Jego odpowiedzi? Szokujące… albo ChatGPT nielegalnie wykorzystuje dane? Kanadyjski urząd ds. prywatności wszczyna dochodzenie.

Choć do wciskania niektórym ściemy nie trzeba dziś AI. Np. wystarczyło okrzyknąć, że jest p$a$n$d$e$m$i$a i stupid19 i już co niektórzy łykają jak pelikany. Chyba że AI wygeneruje – bo po dziś dzień nie wyizolowano z tego co mi wiadomo – takie ‘coś’…