Konferencja Mega Sekurak Hacking Party w Krakowie – 26-27 października!

OSINT kontra dezinformacja, czyli jak zdemaskować trolla [czwartki z OSINTem]

Wydarzenia o dużym ładunku emocjonalnym, takie jak wojna w Ukrainie czy silne trzęsienie ziemi, które miało miejsce w lutym na terenie Turcji i Syrii, stanowią bazę do działań dezinformacyjnych, gdyż przez silne oddziaływanie na ludzkie emocje łatwiej jest spowodować szybką reakcję dużej liczby osób. Możliwe jest jednak wykorzystanie OSINT-u do przeciwdziałania takim praktykom i ujawnienia „sztuczek”, które mogą także wpływać na wnioski wyciągane ze śledztw prowadzonych w Internecie.

Na podstawę zmanipulowanych informacji często wybierane są materiały, które wywołują duże emocje u widzów

Na początek: dlaczego w tytule nie znalazł się znak zapytania

Jednym z często spotykanych sposobów na przyciągnięcie uwagi czytelników gazet i portali informacyjnych jest wykorzystywanie w tytule artykułu pytania, które stanowić będzie clickbait (czyli poprzez swój ładunek emocjonalny będzie nakłaniało do kliknięcia w link do artykułu). Co jednak zrobić, jeśli w opisywanym temacie nie ma nic nadzwyczajnego? W tym przypadku można posłużyć się pytaniem, które będzie na tyle kontrowersyjne, aby zainteresowało potencjalnego czytelnika, np. „Wprowadzą ograniczenie liczby aplikacji instalowanych na smartfonie?”. Zgodnie z tzw. prawem nagłówków Betteridge’a, na każdy nagłówek prasowy zakończony znakiem zapytania można odpowiedzieć „nie”. Prawo to sprawdza się w naprawdę dużej części newsów, publikowanych zarówno w mediach mainstreamowych, jak i mniejszych serwisach, które potrzebują klikalności.

Co jednak w sytuacji, kiedy nawet po przeczytaniu całego artykułu prasowego nie jest możliwe ustalenie, czy informacje w nim zawarte są prawdziwe, czy też są narzędziem manipulacji? Poza podstawową weryfikacją, czy według naszego osądu dany tekst próbuje wzbudzić skrajne emocje, co może być oznaką próby manipulacji, można posłużyć się kilkoma prostymi technikami OSINT-owymi, które ułatwią ustalenie, z czym mamy do czynienia.

Źródło

Pierwszym krokiem przy weryfikacji prawdziwości informacji może być sprawdzenie źródła, z którego pochodzi. Jeśli jest to serwis internetowy, warto zwrócić uwagę, jakie inne informacje się w nim znajdują, tzn. czy na przykład nie jest to strona publikująca same sensacyjne informacje bez odpowiedniej weryfikacji lub czy nie jest to strona o określonym, wąskim zakresie publikacji silnie nacechowanych emocjonalnie. Warto też sprawdzić, kiedy zarejestrowana została domena dla danego serwisu, korzystając z jednego z ogólnodostępnych w Internecie narzędzi do analizy domen, takich jak np. https://whois.domaintools.com lub https://www.whois.com/whois.

W przypadku większych serwisów istnieje znaczne prawdopodobieństwo, że informacja jest prawdziwa, chociaż i dużym graczom zdarzają się wpadki polegające na powtarzaniu niepotwierdzonych informacji, czego przykładem jest słynny filmik z Andrew Tatem i jego pizzą opisywany w jednym z poprzednich odcinków. Dlatego zawsze należy mieć na uwadze fakt, że świeża informacja, szczególnie sensacyjna, mogła nie zostać odpowiednio zweryfikowana, ponieważ w świecie newsów czas odgrywa istotną rolę w wyścigu o pierwszeństwo jego opublikowania.

Możliwe jest także sprawdzenie serwisu informacyjnego, którego nie znamy, a który wydaje się nam podejrzany, w archiwum Internetu, czyli np. w serwisie Internet Archive – Wayback Machine. Jeśli jeszcze niedawno strona wyglądała zupełnie inaczej lub publikowała zupełnie inne treści, może się okazać, że domena została przejęta w wyniku ataku na serwery hostujące lub DNS albo przez wykupienie nazwy domenowej, której ktoś zapomniał przedłużyć lub też celowo tego nie zrobił. Dla bardziej zaawansowanych użytkowników interesującym źródłem będzie także weryfikacja historycznych wpisów DNS, które mogą świadczyć o przejęciu domeny.

Autor

W celu sprawdzenia wiarygodności analizowanej informacji należy zweryfikować, kto jest jej autorem. Oznakami, że informacja jest nieprawdziwa, mogą być (chociaż nie muszą!) następujące wskazówki:

– brak autora informacji,

– autor zajmuje się wyłącznie publikowaniem informacji o dużym ładunku emocjonalnym, ale z różnych dziedzin,

– poza analizowanym przypadkiem zajmuje się on zupełnie inną tematyką (może to oznaczać zarówno próbę manipulacji przez przekupionego autora, jak i przejęcie konta lub próbę podszycia się pod tę osobę),

– konto, które publikuje informacje, powstało niedawno lub niedawno zmieniło nazwę użytkownika albo opis,

– brakuje zdjęcia profilowego konta, jest ono domyślne, skopiowane z innego konta lub innego miejsca w Internecie albo przedstawia osobę, która ewidentnie nie istnieje (np. widać, że zdjęcie zostało wygenerowane przez stronę thispersondoesnotexist.com).

Autorzy dezinformacji często nie zadają sobie zbyt dużo trudu, aby przygotować naprawdę dobre i trudne do wychwycenia zdjęcie dla kont publikujących zmanipulowane informacje, dlatego proste wyszukanie w Internecie danych autora lub wyszukiwanie obrazem zdjęcia profilowego konta może szybko przynieść efekt w postaci potwierdzenia fałszywości danego konta.

Zestawienie kont botów, które publikują dokładnie ten sam tekst. Źródło: https://twitter.com/thefreds/status/1420046140855177224

Często kopiowane są także całe fragmenty tekstu, który stanowi treść zmanipulowanej informacji, co pozwala zidentyfikować wiele kont, używanych do ich rozsiewania dzięki wyszukaniu dłuższego ciągu słów, który podejrzewamy o bycie dezinformacją. Jeśli dokładnie ten sam tekst będzie widniał na wielu, pozornie niepowiązanych kontach, można mieć niemal całkowitą pewność, że trafiliśmy na farmę trolli.

Te same zasady dotyczą komentarzy pod artykułami, w których także trolle rozsiewają dezinformacje i podgrzewają atmosferę dyskusji, aby wywołać kłótnie pomiędzy użytkownikami i (nomen omen) „zaszczepić” w nich swoje teorie. Autorów komentarzy można również w wielu przypadkach zOSINT-ować przy pomocy ich zdjęć profilowych, nazw użytkownika lub powiązanych profili, np. kont Google.

Osobom, które chcą spróbować swoich sił w rozpoznawaniu fałszywych profili w Internecie, polecam serwis SpotTheTroll.

Czas i miejsce

Jednym ze sposobów na dodanie wiarygodności zmanipulowanej informacji jest poparcie jej zdjęciami lub filmami z tego samego miejsca, ale innego momentu czasowego lub z innego miejsca, które tylko z pozoru przypomina to, do którego się odnosimy. Tego typu sytuacje zdarzały się w trakcie wojny w Ukrainie, ale także miały miejsce m.in. po tragicznym w skutkach trzęsieniu ziemi na terenie Turcji i Syrii w lutym 2023 roku. Weryfikacją i demaskowaniem krótkich filmów zamieszczanych w mediach społecznościowych i szerzących nieprawdziwe informacje, zajmuje się wielu dziennikarzy, m.in. Brecht Castel. Na jego koncie na Twitterze można znaleźć wiele przykładów tego typu analiz, w tym także analizę filmu walącego się budynku, który rzekomo został sfilmowany w Turcji.

Tweet Brechta Castela z serii dotyczącej analizy filmu walącego się budynku, który miał mieć związek z trzęsieniem ziemi w Turcji

W analizie belgijski dziennikarz skupił się na kilku aspektach. Po pierwsze krajobraz był raczej letni, podczas gdy zdjęcia i filmy wykonane po trzęsieniu ziemi w Turcji pokazywały zimową scenerię. Zwrócił także uwagę na ludzi, którzy nie wydawali się przejęci zapadającym się budynkiem. Zauważył też, że napisy (w tym na tablicach rejestracyjnych) zawierają znaki alfabetu arabskiego, a nie przypominają napisów tureckich lub syryjskich. W końcu odnalazł źródło filmu, które okazało się przedstawiać miasto Jeddah w Arabii Saudyjskiej, w którym przeprowadzono kontrolowane wyburzenie jednego z budynków. Okazało się także, że te filmy udało się odnaleźć m.in. na TikToku, gdzie pojawiły się już w połowie stycznia 2023 roku, czyli jeszcze przed trzęsieniem ziemi w Turcji. Dalsza analiza konta na Twitterze, które publikowało fałszywie opisany film, ujawniła, że zostało ono utworzone niedawno, ma bardzo małą liczbę śledzących je osób oraz nazwę użytkownika (Twitter handle) niepasującą do nazwy konta, która wraz z linkiem wskazywała na sklep internetowy, a nie na źródło informacyjne.

Grafika komputerowa

W dobie ogólnodostępnych narzędzi wykorzystujących techniki deepfake nie dziwi już manipulacja obrazem lub materiałem wideo polegająca na umieszczaniu w nim nieprawdziwych elementów. Kiedy twórcom manipulacji nie chce się samodzielnie tworzyć sfałszowanych materiałów, korzystają z grafik lub filmów z gier albo filmów. Mój osobisty faworyt to wpis na Twitterze, w którym rosyjska ambasada w Wielkiej Brytanii użyła grafiki z gry Command & Conquer: Generals do ilustracji wpisu mówiącego o otrzymaniu kilkunastu ciężarówek z bronią chemiczną przez ekstremistów niedaleko Aleppo. Gra ma już swoje lata, więc od razu rzuca się w oczy fakt, że nie może to być wizualizacja faktycznych ciężarówek, a dodatkowo na zdjęciu dodany jest napis informujący o tym, że jest to tylko wizualizacja wiadomości, jednak pokazuje to ekstremalny przypadek nieprawdziwej ilustracji.

Ciężarówki z gry Command & Conquer: Generals jako ilustracja wpisu dotyczącego działań ekstremistów w Syrii

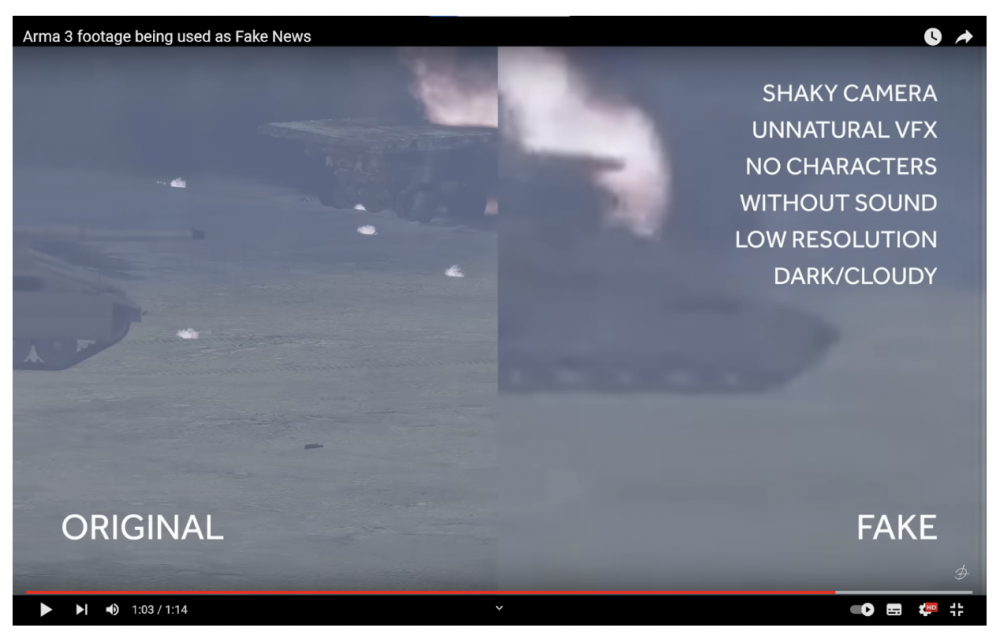

Filmy z innej gry, Arma3, były wykorzystywane do uwiarygodnienia przekazywanych informacji, zarówno o zniszczeniu dużych zapasów sprzętu nieprzyjaciela przez Armię Ukrainy, jak i do zaatakowania rakietami NATO-wskiego konwoju. W obu przypadkach udało się ustalić, że nagrania nie są prawdziwe, jednak zdążyły one już dotrzeć do ogromnej liczby odbiorców. W przypadku drugiego materiału zdążyło go obejrzeć ponad 700 tysięcy osób. Twórcy gry – Bohemia Interactive – opublikowali nawet film na YouTube, w którym pokazują, jakie sztuczki zostały wykorzystane, aby z materiału wideo z ich gry zrobić prawdopodobne nagranie z frontu. Zazwyczaj w takich wypadkach jakość materiału jest obniżana, obraz jest rozmyty i niestabilny pod względem kadru, co miałoby sugerować nagranie wykonane np. kamerą w smartfonie, jednak tak naprawdę są to zabiegi mające ukryć widoczne cechy grafiki komputerowej.

Kadr z materiału producenta gry Arma3, przedstawiający sposoby manipulacji materiałem wideo z gry, w celu stworzenia z niego filmu wyglądającego jak nagranie z frontu

Innym przykładem analizy zmanipulowanych nagrań wideo jest weryfikacja reklam, z których jedna pokazywała warszawskie metro i plakaty namawiające Polaków do zapisywania się na kierowców czołgów w Ukrainie. Miało to być dowodem na „terytorialne ambicje Polski wobec Ukrainy”. Po analizie materiału wideo przez badaczy z Belgii okazało się, że widoczne są w nim cechy nieudolnego nałożenia reklamy na oryginalne nagranie.

Wpis demaskujący fałszywe reklamy, publikowane oryginalnie na kanale na Telegramie

Aby zweryfikować, czy dane nagranie nie jest jedynie grafiką wygenerowaną komputerowo lub pochodzącą z filmu, można pokusić się o jego analizę pod kątem niespójności pomiędzy klatkami lub wyszukiwanie za pomocą wybranych klatek (np. klatek kluczowych) w wyszukiwarkach grafiki. Istnieje szansa, że uda się odnaleźć tę samą scenę, ale w zupełnie innym kontekście.

Wyjście z bańki

Należy pamiętać, że każdy z nas, czy tego chce, czy nie, żyje obecnie w bańce informacyjnej (zwanej też bańką filtracyjną, ang. filter bubble), którą tworzą serwisy internetowe, a wśród nich głównie media społecznościowe. Serwowane tam informacje są dopasowywane do osobistego profilu ich użytkownika tak, aby jak najbardziej przypadły mu do gustu, co ma się z kolei przełożyć na zyski dla takich gigantów jak Google czy Meta (właściciel m.in. Facebooka i Instagrama). Dlatego wiele osób dziwi się, przykładowo: „Jak partia X mogła zdobyć tyle głosów? Przecież wszyscy pisali, że będą głosować na partię Y!”. Winna jest temu właśnie owa bańka filtracyjna, w której znajduje się konto danej osoby w mediach społecznościowych, chociaż można ją rozciągnąć także na życie poza Internetem. Obracamy się raczej w kręgach osób o podobnych poglądach i upodobaniach, co często przekłada się na mylne pojęcie o ogóle społeczeństwa. Aby ujrzeć świat poza bańką, warto wyszukiwać informacji bez logowania się na swoje konta, a także korzystając z wyszukiwarek i serwisów nieprofilujących (przynajmniej teoretycznie) swoich użytkowników, jak np. DuckDuckGo lub Startpage.

Podsumowanie i rady

Dezinformacja towarzyszy nam od dawna, jednak w wyniku coraz większego dostępu do mediów społecznościowych i portali internetowych, a także ze względu na coraz łatwiejsze publikowanie w nich treści o dowolnej tematyce, bez jakiejkolwiek weryfikacji ich prawdziwości, ekspozycja na zmanipulowane informacje jest coraz większa. Na szczęście rosną także możliwości weryfikacji źródeł, autorów i materiałów multimedialnych, głównie przez techniki OSINT-owe. Warto więc za każdym razem, gdy nie jesteśmy pewni co do przedstawianej nam informacji, oprócz weryfikacji na poziomie psychologicznym („czy ta informacja wywołuje u mnie emocje i czy skłania mnie do natychmiastowego działania?”), sprawdzić także inne, bardziej techniczne jej aspekty, aby nie dać się oszukać.

Dla osób, które nie miały jeszcze zbyt wiele (lub wcale) do czynienia ze zdjęciami wygenerowanymi przez mechanizmy GAN na stronie thispersondoesnotexist.com przygotowałem proste narzędzie Am I Real?, dzięki któremu można je zidentyfikować poprzez analizę umiejscowienia na nich oczu i ust. Oczywiście narzędzie przeznaczone jest tylko do nauki i nie można traktować jego wyników jako wyroczni, ale pozwala ono szybko zweryfikować, czy zdjęcie może być sztucznie wygenerowane, czy nie.

Krzysztof Wosiński

@SEINT_pl / @SEINT@infosec.exchange

Co tydzień, w czwartki publikujemy nowy tekst autorstwa Krzyśka Wosińskiego. Jeśli nie chcesz przegapić żadnego odcinka, zapisz się poniżej (okazyjnie możemy Ci też podsyłać inne informacje od ekipy sekuraka):

- OSINT – historia prawdziwa #1 autorstwa Tomka Turby. Czyli szukanie uprowadzonej nastolatki.

- OOPSEC – wpadki i wypadki przy zabezpieczaniu danych. Czyli jak (nie) cenzurować zdjęć i dokumentów autorstwa Krzyśka Wosińskiego.

- OSINT – historia prawdziwa #2 autorstwa Tomka Turby. Czyli szukanie uprowadzonego dziecka.

Nie publikujecie moich komentarzy, trudno, ale czy to nie dezinformacji pilnowanie :-)

Ad hoc w/w artykułu:

1.’Prawo nagłówków’ – no nie na każde ‘nie’, np. Czy będziemy jeść robale?…

2.Kiedy zarejestrowana domena. Nie zawsze krótki czas to ‘zło’. Np. teraz powstają witryny w odpowiedzi na Davosowe wytyczne 2030. Albo np. stara str. Stowarzyszenia STOPZET była na innych serwerach, teraz na innym – ale to do sprawdzenia archive.

Świeża informacja – wystąpienie dziennikarza Witold Hake podczas prac nad drukiem 2861 – autentyk.

3.Kopiowanie całych fragmentów tekstów. Nie zawsze, bo jak chcemy wstawić jakiś komentarz na różnych blogach, stronach w tym samym temacie, to tak się kopiuje, żeby x razy nie klepać w klawiaturę. A te ‘teorie’ można w prosty sposób zweryfikować.

‘Gravatary’ – może chodzić o anonimowość czy konta do śledztw.

4.Czas i miejsce. Ostatni protest pod sejmem 6 marca był przez różne kanały, osoby, z różnych ujęć podawany – sejm, przed sejmem itp.

Podsumowanie i rady

To taka ‘gra’. Równie dobrze można powiedzieć, że na sekuraku jest artykuł ‘OSINT kontra dezinformacja, czyli jak zdemaskować trolla’ bez znaku zapytania, żeby było na ‘nie’.

A i ciekawie wychodzi analiza walenia się budynków WTC…sensu largo.

Jak to Stalin mawiał – ufaj i sprawdzaj.

Dla porównania można poczytać inne artykuły o tym jak trolli zdemaskować i sprawdzić je pod w/w kątem.

Jako uzupełnienie dodam dla czytelników i autora – znalezione na www:

„Ocena wiarygodności źródła jest podstawowym elementem skutecznie działającego wywiadu.

Nie ma możliwości stworzenia jednej definicji wartościowej informacji, ponieważ jest to każdorazowo kwestia subiektywnej oceny.Każde źródło należy oceniać przez pryzmat ryzyka z nim związanego, tj. wprowadzenia go w celu dezinformacji czy też działań propagandowych. Brak skrupulatnego sprawdzania informacji – początkiem końca.

Należy odpowiedzieć sobie na kilkanaście pytań. Im większa liczba potwierdzeń, tym można uznać dane źródło za bardziej wiarygodne.

Czy informacja, którą zdobyliśmy, jest potwierdzana w jakimkolwiek innym źródle? (Jeżeli jednak informacja zawiera innowacyjne dane, nie ma możliwości, aby były one gdzieś potwierdzone).

Czy publikacja jest logiczna? (Publikacje oparte na emocjach zazwyczaj mają dużo elementów związanych z mało wiarygodnymi informacjami).

Relewantność źródła wobec naszych potrzeb: czy źródło w pełnym lub znacznym stopniu wyczerpuje nasze potrzeby, czy też tylko dotyka tematu? (To bardzo ważny element oceny nie tylko jego wiarygodności, ale i przydatności).

Czy informacja pochodzi ze źródła pierwotnego? Jeżeli nie: czy jesteśmy w stanie dotrzeć do miejsca wytworzenia informacji? (Miejsce publikacji informacji jest równie ważne, np. inna ocena wiarygodności należy się informacji z portalu specjalistycznego, a inna z plotkarskiego).

Czy źródło jest rekomendowane przez ekspertów związanych z daną dziedziną?

Czy źródło zawiera fakty, które są poparte dowodami, czy są to TYLKO opinie? (Nie mówię, że same opinie od razu przekreślają źródło, ale warto, aby każda z nich była poparta dowodami).

Czy znamy autora informacji, a jeżeli tak, to czy jest on wiarygodny? (Czy da się sprawdzić autora, np. kontaktując się z nim; czy jest on ekspertem w danej dziedzinie? Czasem niektóre informacje posiadają anonimowego autora, co powinno wzbudzić szczególną ostrożność).

Czy wiesz, z jakiego środowiska jest autor (przedsiębiorca/uczelnia)? Jeżeli tak: czy to środowisko jest wiarygodne?

Czy znasz branżę związaną z daną informacją, a jeżeli tak, czy według Ciebie jest ona wiarygodna? (Czy na przykład nie tworzy treści nastawionych na reklamę zamiast neutralnych opinii?)

Czy pojawiły się już jakieś komentarze na temat danej informacji? (Czy eksperci z danej dziedziny wypowiadali się na ten temat? Jeżeli nie, można poprosić ich o komentarz).

Czy można sprawdzić aktualność informacji? (Czy znalezione informacje mają datę publikacji, czy któryś z elementów w treści nie zawiera informacji nieaktualnych?)

Czy na źródło powoływał się ktoś wiarygodny?

Czy źródło wygląda profesjonalnie? (Jeżeli na przykład informacje pozyskujemy z Internetu, należy sprawdzić kilka danych na temat strony, tj. popularność, użyteczność oraz dostępność strony).

Czy znalezione informacje są kompletne? (Czy wyczerpują nasze zapotrzebowanie informacyjne na dany temat?)

Czy źródło reprezentuje czyjeś interesy, a jeżeli tak, czy wiemy, jakie to są interesy? (Obiektywizm źródła to ważny element, choć bardzo rzadki. Zawsze warto zadać to pytanie, prościej nam będzie wtedy odpowiedzieć sobie na inne: czemu dany autor publikował tego typu informację – a przez to jej ocena będzie znacznie łatwiejsza).

Nie zawsze ocena wiarygodności źródła jest tak prosta, a informacja, którą pozyskaliśmy, może mieć bardzo mało potwierdzeń w powyższych pytaniach. Dzieje się tak przede wszystkim podczas poszukiwania informacji zawierających innowacyjne dane – nie zawsze trzeba je odrzucać. Wszystko pozostaje w rękach analityka– im jest on sprawniejszy i bardziej doświadczony, tym większa szansa, że odpowiednio oceni wiarygodność informacji. Żyjemy w świecie, w którym aby wyprzedzić konkurencję, często trzeba ryzykować, jednak przekazując daną informację dalej, np. osobie decyzyjnej, należy wtedy jasno zaznaczyć, że nie udało się potwierdzić wiarygodności źródła.”

Tak może douzupełnię, na bazie www- może ktoś kiedyś tu trafi, to będzie miał ‘komplet info’.

Kolejną przeszkodą na drodze do oceny wiarygodności są tzw. błędy poznawcze. O błędzie poznawczym mówimy wtedy, gdy dokonujemy nieracjonalnej oceny rzeczywistości. Do najpopularniejszych z błędów poznawczych, o których mówią nauki społeczne należą:

Efekt autorytetu – zakładanie, że dane twierdzenie musi być prawdą jeśli zostało sformułowane przez osobę będącą autorytetem. Bardzo często przy tym dochodzi do bezpodstawnego uznania kogoś za autorytet w danej dziedzinie (np. pielęgniarka czy ratownik medyczny uznawani za ekspertów od szczepień ponieważ pracują w służbie zdrowia).

Efekt potwierdzenia – tendencja do poszukiwania wyłącznie faktów potwierdzających posiadaną opinię, a nie weryfikujących ją.

Efekt wspierania decyzji – tendencja do lepszego pamiętania argumentów przemawiających za podjętą już decyzją niż przeciwko niej.

Efekt zaprzeczania – tendencja do krytycznego weryfikowania informacji, które zaprzeczają dotychczasowym opiniom, przy jednoczesnym bezkrytycznym akceptowaniu informacji, które je potwierdzają.

Zasada podczepienia – tendencja do robienia czegoś lub wierzenia w coś tylko dlatego, że wiele osób tak robi.

Powodują, że dużo lepiej zapamiętujemy fakty, które są potwierdzeniem naszych przekonań, nawet jeśli tych przeczących jest znacznie więcej; powodują, że tak ciężko jest nam zmienić przekonania.

Błędy poznawcze są również bardzo chętnie wykorzystywane przez osoby manipulujące opinią publiczną. Wspomniana zasada podczepienia (znana też jako społeczny dowód słuszności) leży u podstaw Goebbelsowskiego twierdzenia, że kłamstwo powtórzone tysiąc razy staje się prawdą.

Elementy, które sprawiają, że wojna informacyjna jest skuteczna:

Brak czasu, chęci lub zdolności do weryfikowania faktów w różnych źródłach.

Brak logicznej argumentacji, zamiast tego emocjonalna reakcja na inny punkt widzenia.

Błędy poznawcze – łatwość zapamiętywania informacji zgodnych z naszym światopoglądem, brak krytycznego podejścia, zaufanie do autorytetów, które tak naprawdę nimi nie są. Również sympatie i przekonania, które powodują, że odbieramy świat jako czarno-biały. Jeśli ktoś w jakimś aspekcie prezentuje postawę, z którą się nie zgadzamy to wszelkie jego opinie będziemy traktować jako niegodne zaufania (i odwrotnie).

Bańka informacyjna – efekt działania algorytmów w sieciach społecznościowych.

Ograniczone (u niektórych wybitnie) zdolności do przetwarzania, analizowania i interpretowania informacji

Łatwowierność w teorie (również spiskowe) za sprawą ich przedstawienia w sposób sensacyjny i atrakcyjny, tak by nie pozostawiały miejsca na żadne wątpliwości.

Różnorodność odbiorców.

Techniki manipulacji (np. zasada 40/60, społeczny dowód słuszności, kłamstwo powtarzane tysiąc razy).

perfidia osób, które wykorzystują manipulację.

Miejmy zatem ograniczoną wiarę w organizacje, które zajmują się tzw. fact-checkingiem – publikują one na bieżąco analizy dotyczące ‘wiarygodności aktualnych doniesień medialnych’

To wie tylko Adam

Mam wrażenie, że Polskie serwisu społecznościowe (wykop, demotywatory itd) zalewają treści sztuczne oraz grupy ludzi lub botów mające robić określone narracje pozytywne lub negatywne na niewygodne tematy. Jak można się przed czymś takim bronić, jak to praktycznie jest od już długiego czasu skala masowa. Dostrzega to wiele osób co korzysta z tych sieci i też to komentują. Ale wydaje się to być bardzo niebezpieczne w tych czasach bo tym urabiają opinie społeczne – sztucznymi farmami pseudo użytkowników i ich kreacją reakcje lub poglądów.

1.’Prawo nagłówków’ – no nie na każde ‘nie’, np. Czy będziemy jeść robale?…

XDD Serio, dałeś się zmanipulować jak dzieciak. Przeczytaj dokumentu unijne na ten temat i przestań powielać fejki.

Już pomijam nawet fakt, że robaki były używane między innymi do produkowania barwników w żywności zanim się zrobił hype na to XD.

Dokładnie!

Może warto żeby doczytał sobie choćby skąd jest pozyskiwana czerwień koszenilowa tak popularna choćby w żelkach. ;)

Czy będzie powrót serii “Bug of the Week?” Najlepsza seria i super, że tworzyliście przykładowe appki z błędem.

raczej nie ;(